« Les tests PISA »

Entre le 16 avril et le 31 mai 2018 (1), les écoles secondaires de Belgique participeront à "l'enquête Pisa", celle-là même qui, en Fédération Wallonie-Bruxelles, aurait justifié la construction du Pacte pour un Enseignement d'Excellence. Le moment nous paraît donc idéal pour faire les présentations ... en toute simplicité.

1. Les "tests Pisa" sont réalisés tous les ans sur ordre du Ministère de l'Education. Ils visent tous les jeunes d'un niveau scolaire précis et portent sur les connaissances de ceux-ci.

FAUX ! Le Programme International pour le Suivi des Acquis des élèves (PISA) est une évaluation créée par l’OCDE, qui vise à tester les compétences des élèves de 15 ans. Il s’agit d’une enquête menée tous les trois ans. Elle a pour objectif de fournir aux différents acteurs (décideurs politiques, autorités scolaires, enseignants, ... ) des données comparatives permettant d’estimer dans quelle mesure les élèves disposent des compétences pour jouer un rôle actif dans la société.(2)

Remarquons déjà qu'en l'affaire, l'OCDE, Organisation de Coopération et de Développement Economiques, joue à la fois le rôle de prescripteur et d’évaluateur : "nous évaluons, vous évoluez" (un peu comme si une firme pharmaceutique expertisait ses produits et établissait l’ordonnance pour le patient !). Relevons aussi le fait que le critère pour constituer le public-cible est uniquement l'âge des élèves (15 ans), quels que soient leurs niveau et type d'enseignement : le plus souvent des élèves de 3e/4e année, de l'enseignement général, technique, artistique et professionnel (donc universellement en fin de parcours scolaire obligatoire et tous dans la même classe si on applique le passage automatique de classe). Pointons enfin que le programme PISA ne se fonde pas sur les programmes scolaires et ne vise pas à analyser le rendement spécifique de l’enseignement secondaire à un moment précis du parcours scolaire. En interrogeant les jeunes à l’âge de 15 ans, quel que soit leur parcours scolaire, l’objectif de Pisa est d’évaluer des compétences essentielles pour la vie future des jeunes. Ce ne sont donc pas les compétences ou connaissances effectivement enseignées dans les classes qui sont évaluées ici, mais plutôt l’utilisation d’un bagage permettant la compréhension en profondeur et la résolution de situations qu’un adulte pourrait être amené à rencontrer dans sa vie personnelle, publique ou professionnelle. Sont donc analysées l’autonomie, la spontanéité créatrice, la réactivité devant l'inconnu, la formation continue et la bonne humeur incessante !

Finalement, il s'agit donc bien de mesurer, à travers ces tests, l'employabilité, dans l'économie mondialisée, des futurs salariés malléables et précaires.

2. Les tests sont créés par des professeurs et des pédagogues de chaque pays et dans la langue du pays où ils seront "administrés". L'organisation n'est donc que chapeautée par l'OCDE et est laissée à la libre organisation de chaque pays.

VRAI ET FAUX. L'organisation des "tests Pisa" est à la fois internationale et nationale.

Chaque pays mène sa propre enquête : les Etats participant à PISA collectent eux-mêmes les données, en étroite collaboration avec la direction internationale du projet. Chaque Etat finance sa propre enquête et assume une partie des coûts internationaux.(3)

Le rôle du consortium international : le secrétariat de l’OCDE assume la direction générale du programme, tandis que les principales décisions sont prises conjointement dans le cadre du PGB (PISA Governing Board) par les gouvernements des pays participants. Comme pour les enquêtes précédentes, pour PISA 2018, un consortium international a été chargé d’assurer la réalisation du projet sur les plans pratique et technique, de coordonner ce dernier au niveau international et de veiller à l’application du concept élaboré par l’OCDE pour comparer les compétences des élèves.

Les tests se déroulent en 3 phases, organisées par un consortium de différents instituts de recherches (autrefois l'australien ACER et, depuis 2015, l'américain ETS) sous l'égide de l'OCDE. La première année voit la définition des objectifs et mise au point des instruments de mesure (les items). Ceux-ci sont imaginés par des groupes d'experts internationaux et par le consortium à partir d'un cadre de référence international. Sont créés environ 160 items (QCM ou questions ouvertes), rédigés en anglais puis traduits en français (2e langue de l’OCDE). Des traductions sont ensuite faites vers d’autres langues. Au cours de la deuxième année, on expérimente les instruments et les procédures de collecte ("test des items"). Et c'est la troisième année que se fait l'évaluation proprement dite. (4)

3. Tous les élèves de 15 ans de toutes les écoles du monde entier participent à ces tests.

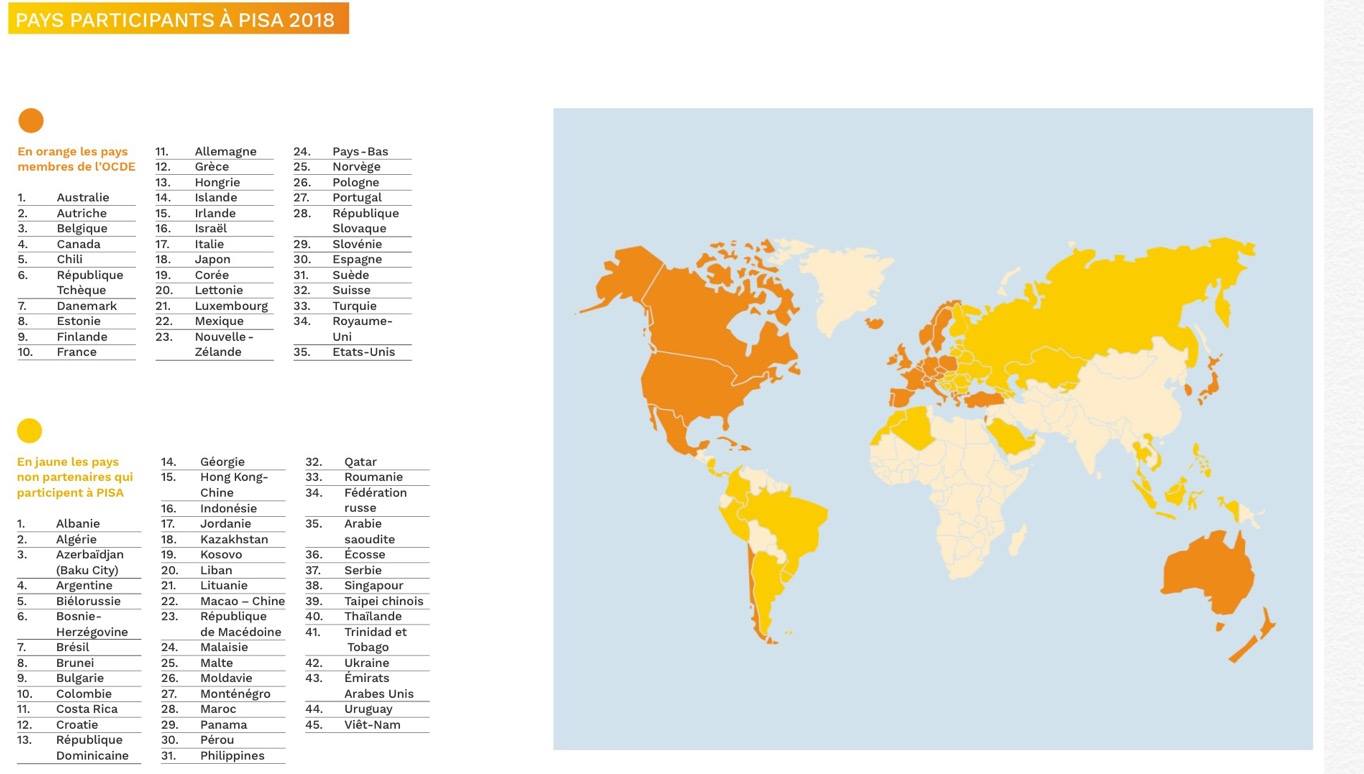

FAUX ! Les 35 pays de l'OCDE participent d'office aux sessions. S'y ajoutent des pays partenaires, dont la liste peut varier d'une session à l'autre, certains voulant entrer dans cette évaluation, d'autres au contraire préférant "passer leur tour". (5)

La sélection des élèves participant aux tests Pisa se fait à partir d'un échantillon aléatoire d'écoles publiques et privées. Par exemple, pour les tests de 2015 étaient concernés tous les élèves nés entre le 1/1/1999 et le 31/12/1999. Un tirage au sort retient alors 150 écoles représentatives dans chaque "pays" et 42 élèves par école (si le "pays" est trop petit, ex. Luxembourg, Malte, toutes les écoles du "pays" sont sélectionnées). On obtient ainsi le nombre d’environ 540.000 élèves représentatifs des 29 millions de jeunes dans 72 pays concernés.

En 2018, ce seront les élèves de 80 pays qui seront tirés au sort, 35 élèves par école "représentative". On voit dès lors que l'échantillon "élèves" peut varier d'une session à l'autre. (6)

Dans l’échantillon en FWB, les différents réseaux sont représentés dans des proportions équivalentes à celles qu’ils occupent dans l’ensemble de la population scolaire en Communauté française. Il en va de même en ce qui concerne la représentativité de l’enseignement spécialisé.

Entre le 16 avril et le 31 mai 2018 (1), les écoles secondaires de Belgique participeront à "l'enquête Pisa", celle-là même qui, en Fédération Wallonie-Bruxelles, aurait justifié la construction du Pacte pour un Enseignement d'Excellence. Le moment nous paraît donc idéal pour faire les présentations ... en toute simplicité.

1. Les "tests Pisa" sont réalisés tous les ans sur ordre du Ministère de l'Education. Ils visent tous les jeunes d'un niveau scolaire précis et portent sur les connaissances de ceux-ci.

FAUX ! Le Programme International pour le Suivi des Acquis des élèves (PISA) est une évaluation créée par l’OCDE, qui vise à tester les compétences des élèves de 15 ans. Il s’agit d’une enquête menée tous les trois ans. Elle a pour objectif de fournir aux différents acteurs (décideurs politiques, autorités scolaires, enseignants, ... ) des données comparatives permettant d’estimer dans quelle mesure les élèves disposent des compétences pour jouer un rôle actif dans la société.(2)

Remarquons déjà qu'en l'affaire, l'OCDE, Organisation de Coopération et de Développement Economiques, joue à la fois le rôle de prescripteur et d’évaluateur : "nous évaluons, vous évoluez" (un peu comme si une firme pharmaceutique expertisait ses produits et établissait l’ordonnance pour le patient !). Relevons aussi le fait que le critère pour constituer le public-cible est uniquement l'âge des élèves (15 ans), quels que soient leurs niveau et type d'enseignement : le plus souvent des élèves de 3e/4e année, de l'enseignement général, technique, artistique et professionnel (donc universellement en fin de parcours scolaire obligatoire et tous dans la même classe si on applique le passage automatique de classe). Pointons enfin que le programme PISA ne se fonde pas sur les programmes scolaires et ne vise pas à analyser le rendement spécifique de l’enseignement secondaire à un moment précis du parcours scolaire. En interrogeant les jeunes à l’âge de 15 ans, quel que soit leur parcours scolaire, l’objectif de Pisa est d’évaluer des compétences essentielles pour la vie future des jeunes. Ce ne sont donc pas les compétences ou connaissances effectivement enseignées dans les classes qui sont évaluées ici, mais plutôt l’utilisation d’un bagage permettant la compréhension en profondeur et la résolution de situations qu’un adulte pourrait être amené à rencontrer dans sa vie personnelle, publique ou professionnelle. Sont donc analysées l’autonomie, la spontanéité créatrice, la réactivité devant l'inconnu, la formation continue et la bonne humeur incessante !

Finalement, il s'agit donc bien de mesurer, à travers ces tests, l'employabilité, dans l'économie mondialisée, des futurs salariés malléables et précaires.

2. Les tests sont créés par des professeurs et des pédagogues de chaque pays et dans la langue du pays où ils seront "administrés". L'organisation n'est donc que chapeautée par l'OCDE et est laissée à la libre organisation de chaque pays.

VRAI ET FAUX. L'organisation des "tests Pisa" est à la fois internationale et nationale.

Chaque pays mène sa propre enquête : les Etats participant à PISA collectent eux-mêmes les données, en étroite collaboration avec la direction internationale du projet. Chaque Etat finance sa propre enquête et assume une partie des coûts internationaux.(3)

Le rôle du consortium international : le secrétariat de l’OCDE assume la direction générale du programme, tandis que les principales décisions sont prises conjointement dans le cadre du PGB (PISA Governing Board) par les gouvernements des pays participants. Comme pour les enquêtes précédentes, pour PISA 2018, un consortium international a été chargé d’assurer la réalisation du projet sur les plans pratique et technique, de coordonner ce dernier au niveau international et de veiller à l’application du concept élaboré par l’OCDE pour comparer les compétences des élèves.

Les tests se déroulent en 3 phases, organisées par un consortium de différents instituts de recherches (autrefois l'australien ACER et, depuis 2015, l'américain ETS) sous l'égide de l'OCDE. La première année voit la définition des objectifs et mise au point des instruments de mesure (les items). Ceux-ci sont imaginés par des groupes d'experts internationaux et par le consortium à partir d'un cadre de référence international. Sont créés environ 160 items (QCM ou questions ouvertes), rédigés en anglais puis traduits en français (2e langue de l’OCDE). Des traductions sont ensuite faites vers d’autres langues. Au cours de la deuxième année, on expérimente les instruments et les procédures de collecte ("test des items"). Et c'est la troisième année que se fait l'évaluation proprement dite. (4)

3. Tous les élèves de 15 ans de toutes les écoles du monde entier participent à ces tests.

FAUX ! Les 35 pays de l'OCDE participent d'office aux sessions. S'y ajoutent des pays partenaires, dont la liste peut varier d'une session à l'autre, certains voulant entrer dans cette évaluation, d'autres au contraire préférant "passer leur tour". (5)

La sélection des élèves participant aux tests Pisa se fait à partir d'un échantillon aléatoire d'écoles publiques et privées. Par exemple, pour les tests de 2015 étaient concernés tous les élèves nés entre le 1/1/1999 et le 31/12/1999. Un tirage au sort retient alors 150 écoles représentatives dans chaque "pays" et 42 élèves par école (si le "pays" est trop petit, ex. Luxembourg, Malte, toutes les écoles du "pays" sont sélectionnées). On obtient ainsi le nombre d’environ 540.000 élèves représentatifs des 29 millions de jeunes dans 72 pays concernés.

En 2018, ce seront les élèves de 80 pays qui seront tirés au sort, 35 élèves par école "représentative". On voit dès lors que l'échantillon "élèves" peut varier d'une session à l'autre. (6)

Dans l’échantillon en FWB, les différents réseaux sont représentés dans des proportions équivalentes à celles qu’ils occupent dans l’ensemble de la population scolaire en Communauté française. Il en va de même en ce qui concerne la représentativité de l’enseignement spécialisé.

4. Les tests Pisa se déroulent tous de la même façon pour tous les élèves participants.

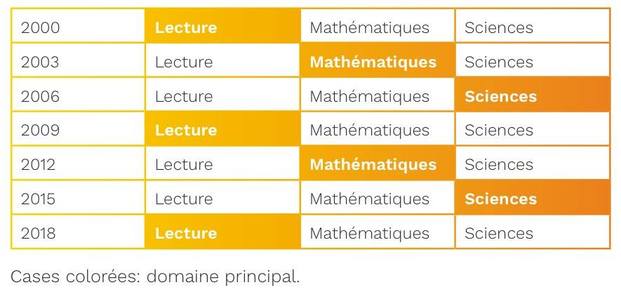

VRAI, avec quelques restrictions. Depuis la session de 2015, les élèves travaillent d’abord 2 heures sur un ordinateur. Ils ont reçu des blocs de questions (QCM, questions ouvertes à argumenter, exercices interactifs ...). Les questionnaires ont été distribués aléatoirement d'un élève à l’autre et d’un pays à l’autre (les tests ne sont donc pas totalement identiques pour tous les élèves de tous les pays). Les tests portent sur la "littératie" (7), les mathématiques et les sciences, mais un domaine est privilégié lors de chaque session (en 2018, le domaine majeur sera la “littératie”, les deux autres domaines ne représentant à eux deux qu'1/3 du questionnaire). (8)

VRAI, avec quelques restrictions. Depuis la session de 2015, les élèves travaillent d’abord 2 heures sur un ordinateur. Ils ont reçu des blocs de questions (QCM, questions ouvertes à argumenter, exercices interactifs ...). Les questionnaires ont été distribués aléatoirement d'un élève à l’autre et d’un pays à l’autre (les tests ne sont donc pas totalement identiques pour tous les élèves de tous les pays). Les tests portent sur la "littératie" (7), les mathématiques et les sciences, mais un domaine est privilégié lors de chaque session (en 2018, le domaine majeur sera la “littératie”, les deux autres domaines ne représentant à eux deux qu'1/3 du questionnaire). (8)

Les questions présentent différents degrés de complexité et sont données dans un ordre aléatoire.

En plus des épreuves « matières », les élèves sont invités à remplir différents questionnaires contextuels. Cela concerne leurs caractéristiques personnelles (sexe, milieu socio-économique, langue parlée à la maison, organisation de la famille,...), leur attitude envers l’apprentissage et l’école, leurs loisirs, leurs habitudes et point de vue sur les cours, leur motivation dans le contexte scolaire, .... (9)

ET FAUX AUSSI. En 2018, pourront apparaître de nouveaux items (en réalité, leur présence est laissée à l'appréciation et au libre choix de chaque pays participant et nous ne savons donc pas ce qu’il en sera pour la Belgique). Ce sont les "global competence" et la "financial literacy".

Le module “compétence globale” (global competence) : Pearson, une entreprise privée sise aux Etats-Unis et spécialisée dans la formation, travaille actuellement à la définition du contenu du domaine global competence proposé à titre d’option. Les premières ébauches donnent l’impression qu’il s’agit d’une notion très large, difficile à appréhender et à mesurer dans une comparaison internationale. Ainsi, la maîtrise de langues étrangères devrait sans doute être considérée comme un élément important d’une global competence pour un élève suisse, alors qu’elle serait secondaire pour un élève américain. Le concept développé ne donne pour l’instant pas d’indications claires quant à la manière de gérer ces exigences différenciées dans une comparaison internationale. C’est la raison pour laquelle ce concept a été discuté de façon critique au sein du PISA Governing Board (PGB). On ne sait pas, pour l’instant, quels pays introduiront ce module, même si la contribution de Christoph Kemper (Université de Luxembourg) est achevée depuis l’automne 2015. (10)

L'option "culture financière" (financial literacy) : l’option culture financière a déjà rejetée par certains pays - dont la Belgique - pour PISA 2012 et PISA 2015 car, à quelques exceptions près, l’enseignement de connaissances financières spécifiques ne faisait pas partie des matières obligatoires alors en vigueur dans les programmes scolaires. Pour PISA 2018, cet état de fait n’aura pas fondamentalement changé, mais rien n'empêchera un pays d'inclure ce module "culture financière" dans les tests de cette année !

5. Les élèves reçoivent le résultat chiffré de leur "prestation", soit personnellement, soit par le biais de leur école.

FAUX ! Les élèves ne sont que des échantillons. D'ailleurs, ils ne répondent pas aux tests sous leur nom, mais avec le numéro de code qui leur a été attribué. En outre, les réponses n’ont pas la même valeur, puisque les élèves sont cotés non sur leurs réponses, mais sur leurs compétences à répondre.

De plus, les administrateurs Pisa “extrapolent” les réponses, puisque tous les élèves ne reçoivent pas le même questionnaire (celui-ci leur ayant été octroyé de façon aléatoire).

6. Les questionnaires Pisa ne comportent que des questions destinées aux élèves.

FAUX ! Les directions d’école reçoivent également des questionnaires portant sur les caractéristiques démographiques de leur établissement scolaire, les ressources de l'école, la qualité de l'environnement d'apprentissage et sur la collaboration avec les parents. Les renseignements contextuels obtenus via ces questionnaires sont mis en relation avec les résultats et sont très utiles à leur interprétation. Ils permettent de comparer les résultats internationaux sous différents angles : ampleur des différences entre les scores des filles et des garçons, liens entre les résultats obtenus et les sommes d’argent investies par les différents pays dans l’enseignement, réussite des élèves provenant de milieux socio-économiquement défavorisés, etc. Ces différentes analyses permettent notamment de mettre en évidence que certains systèmes éducatifs sont plus inégalitaires que d’autres.

Les parents sont également questionnés sur le parcours précédent de leur enfant, leur attitude personnelle par rapport au sujet des tests Pisa (sciences, mathématiques, “littératie”) et sur la perception qu’a leur enfant de l'école. A noter toutefois que, sans doute par souci d'économie, les tests Pisa en FWB ne présentent pas ce volet "parental".

7. Les tests Pisa servent à classer les pays sur une échelle de performance ???

FAUX ! Le but de cette enquête PISA est clairement double : comparer, tous les 3 ans, les élèves d'environ 15 ans dans un certain nombre de pays et amener les pays moins performants à adopter les réformes des pays plus performants.

Pourquoi alors apparaît-il si important de participer à ces tests ?

“Tout d'abord, participer à l’enquête PISA permet aux systèmes éducatifs et aux gouvernements d’identifier les points forts et les aspects encore à améliorer. En deuxième lieu, PISA offre la possibilité de comparer, au niveau international, les compétences des élèves ainsi que les systèmes éducatifs. La comparaison permet de se positionner dans le contexte international et d'apprendre par la comparaison des systèmes éducatifs des différents pays participants. Troisièmement, les données collectées à travers l’enquête PISA ne donnent pas uniquement la possibilité de monitorer les compétences scolaires des élèves mais livrent également des informations sur la vie scolaire et extrascolaire des élèves de 15 ans. Ces informations peuvent être utilisées pour améliorer les méthodes d’apprentissage en les adaptant aux attentes et aux pratiques des élèves. Enfin, grâce à l’approche par compétences, le programme PISA mesure également le niveau de préparation des élèves, lorsqu’ils sont confrontés à des situations nouvelles, que ce soit dans un contexte scolaire, personnel ou professionnel.” (11)

DONC, PISA, FINALEMENT ?

Sans contester le fait que l'enseignement doit sans cesse s'évaluer et être évalué, l'organisation des tests Pisa et surtout leur philosophie et leur utilisation nous semblent erronées sur plusieurs points, voire dangereuses. En voici quelques-uns. Ironie suprême, ils rejoignent l'avis qu'exprima, en 2002, dans la Revue Nouvelle, le professeur Marc Romainville ( oui, celui qui a travaillé plus qu'activement dans la construction du Pacte Pour un Enseignement d'Excellence ! (12)

1/ Les tests Pisa, tels qu'organisés actuellement, ne tiennent pas compte de la spécificité des programmes éducatifs nationaux, ni du volume horaire de chaque discipline, ni du pourcentage d'allophones (et du fait que les “testés” sont issus de 50 nationalités différentes), ni des antécédents culturels différents (pensez, par exemple à l'histoire de la Finlande). Or ces antécédents culturels entraînent les réactions différentes des élèves devant les questions. (13)

Les tests Pisa ne tiennent pas compte non plus de la fraction d'élèves scolarisés d'un pays à un autre, et donc du taux de représentativité. Ainsi, 95% des jeunes sont scolarisés en Grande-Bretagne, 55% seulement au Brésil; Shanghai exclut de la scolarité les enfants de migrants du reste de la Chine (et l'OCDE ferme les yeux sur cette ségrégation). La temporalité de l'apprentissage est aussi totalement oubliée. Or, il nous semble évident à nous, les "gens du terrain", qu'il ne faut pas confondre ce qu'un enfant sait faire à 15 ans et ce qu'il saura ou pourra faire (cf., à ce propos, le problème de la Finlande au niveau de son enseignement supérieur !)

Sont occultés aussi deux écueils inhérents à ce genre de tests : leur marge d'erreur et ne disons pas le "mensonge", mais plus consensuellement, l’amour-propre, la volonté d'embellir ou, au contraire, de dramatiser, voire l’ignorance dans le chef de certains pays, de certaines directions d’école, de certains parents.

Dans les faits, les résultats Pisa ne montrent que des écarts d'un test à l'autre, d'un pays à l'autre, avec des pourcentages, en fait, très petits.

Enfin, un aspect échappe, volontairement ou non, aux organisateurs des tests : le coût de ces enquêtes pour les petits pays, au point que, pour des raisons de budget, certains font l’impasse sur une partie des tests.

2/ On l'a vu aussi, les tests n'évaluent que trois domaines (les mathématiques, les sciences et la “littératie”) - sans tenir compte d'autres cours considérés comme accessoires et pourtant participant aussi à la formation des élèves (tels l'histoire, la géographie, les langues étrangères, les langues anciennes, ...) au risque de reléguer ces cours jugés "inutiles" et de mépriser des connaissances et compétences transversales indispensables (ex. les gammes, les langues anciennes, ...)

3/ On est en droit de se demander si la base-même des tests Pisa n’est pas bancale. En effet, ils se fondent sur une idée de "socle commun" national et international, d'un acquis de base national et international. Or, il existe un grand nombre de redoublements - entre autres en France et en FWB - et tous les élèves de 15 ans, en l'occurrence ici les "testés", ne sont pas à niveau pour les connaissances et la maturité. Dans le même ordre d’idée, notons que, alors que les programmes nationaux présentent une approche différente sur la construction d'un savoir à longue durée, les tests, eux, sont en dehors de toute considération des programmes nationaux.

Deuxièmement, les tests canalisent les objectifs éducatifs en installant une concurrence entre les écoles ou les pays. Outre le fait d'une mauvaise utilisation des tests eux-mêmes, les tests n'ayant pas pour but de classer, mais de comparer ! - cela entraîne un appauvrissement des curricula scolaires : l’enseignement tend à être recentré sur les compétences de base telles qu'utilisées par les tests (juste pour grimper dans le classement). Ces deux derniers points entraînent une perte de qualité de l’enseignement et, aspect tout aussi grave, les pays perdent la maîtrise de leur éducation formelle et de ses finalités profondes.

Troisièmement, les tests mesurent des compétences de la vie réelle. C’est un déni du droit à l'enfance, l'élève n'étant vu et testé que comme un adulte en miniature !

4/ Un problème réside dans l'utilisation, depuis 2015, de questionnaires informatisés, sans avoir au préalable posé la question de savoir quels effets l’utilisation de ce matériel aurait sur les élèves. Or certains problèmes et faiblesses de ces tests informatisés sont apparus en 2015 (difficulté de certains jeunes à les utiliser; impossibilité de revenir en arrière sur une réponse; comportement différent des élèves devant l'ordinateur selon leur nationalité - encore un point de vue culturel occulté). En outre, le recours à l’ordinateur aux tests 2015 a présenté un problème de méthodologie : il y a eu le changement du prestataire chargé de l'enquête (l'américain ETS au lieu de l'australien ACER). Or, les deux prestataires n’ont pas tout à fait la même méthode d'évaluation, ce qui explique partiellement la chute des scores aux tests 2015 - ceux qui, en FWB, ont justifié la mise en construction du Pacte Pour un Enseignement d'Excellence !

5/ Les questions elles-mêmes posent aussi problème. Déjà du temps des questionnaires "papier-crayon", certains avaient attiré l'attention sur une difficulté liée à la langue-même des questions (certaines langues sont moins concises que d'autres, comme le français, 15% plus long que l'anglais). Certains items sont des questions-pièges, surtout pour des adolescents : insertion dans l'énoncé d'informations inutiles; exigence d'une réponse unique, alors que le bon sens en admettrait plusieurs; demande de réponse sans préciser que plusieurs sont attendues; points attribués non pas pour la compréhension d'un texte, mais pour la compréhension de la question du test Pisa (termes abstraits, ...).

Les tests Pisa présentent un autre danger : celui du bachotage (surtout si l’évaluation des professeurs se fait selon les taux de "réussite" de leurs élèves, comme cela se fait déjà dans un Etat des USA où les enseignants reçoivent rémunération ou sanction selon le score de leurs élèves aux tests Pisa !). Sans en arriver à ces extrêmes, il est tentant de bachoter : en effet, les questionnaires des années précédentes circulent sur le net, facilité et possibilité qui poussent certains enseignants, écoles ou pays, à entraîner les élèves. Le risque est grand alors que, dans leurs cours, les professeurs mettent l'accent sur "comment réussir les tests ?", aux dépens d'autres tâches importantes, et qu'en fait, Pisa n'évalue plus les compétences pour répondre aux tests, mais bien la connaissance du test lui-même, ses trucs, ses pièges (un de ces pièges étant la formulation-même des questions, puisque, pour la plupart des élèves testés, elles sont la traduction des items anglais et français. cf. supra)

6/ L'évaluation Pisa met sur le même pied des pays socialement et économiquement différents, c'est-à-dire, en fait, non pas des pays à des stades différents de développement, mais - comme le dit l'OCDE - "des pays et des économies partenaires" ! Est-ce admissible que ces tests comparent nos élèves à ceux de Corée du S., où les cours particuliers occupent une énorme place ? nos élèves à ceux de Shanghai, où tous les élèves ne sont pas scolarisés ? nos élèves à ceux des régions chinoises en plein développement industriel, financier et économique (ainsi, Shanghai, Hong Kong, Macao) et peu représentatives du reste de la Chine ? En quoi les résultats des tests sont-ils significatifs, lorsqu'on compare avec des pays confettis ou de simples villes ? (13) Est-il scientifiquement "honnête" de comparer avec certains pays où existe un système éducatif parallèle, toujours très onéreux pour les parents, se superposant au système national (ex. Grèce, Corée) ?

7/ On compare des chiffres sans savoir ce que l'on compare (ça fait moderne et scientifique ! ). Les scores moyens d'un pays sont souvent affectés d'une marge d'erreur (~ 5%) dans le décodage des réponses. Ainsi, un score 523 dans un test Pisa représente en fait un score de 518 à 528 - ce qui peut changer totalement le score et la place d’un pays dans le classement !

8/ Dans les rapports de synthèse de l'OCDE, on constate que tous les pays enseignant par compétence (comme la Belgique) au détriment des savoirs voient leurs scores chuter. En effet, une compétence se travaille mais ne s'enseigne pas ! Pourtant, les tests Pisa continuent à "estimer dans quelle mesure les élèves disposent des compétences pour jouer un rôle actif dans la société" ! (2)

9/ Les médias jouent un grand rôle dans la publication des résultats des tests : ce sont eux qui mettent en avant un classement, un palmarès. Par là-même, ce sont eux qui créent un sentiment de culpabilité et ouvrent largement la porte aux changements politiques d'organisation scolaire, à une "refondation de l'école".

En conclusion, l'esprit général de Pisa apparaît très fortement critiquable et dangereux : il implique une logique de court terme, à savoir la préparation d'individus employables et flexibles. Pisa participe donc à une marchandisation de l’enseignement, sans réflexion politique sur les valeurs et le but de l’enseignement, mais bien sur son coût et sa rentabilité !

(1) http://www.enseignement.be/index.php?page=25703&ne_id=5339 - FWB, circulaire 6500, du 22/01/2018 :

http://enseignement.be/upload/circulaires/000000000003/FWB%20-%20Circulaire%206500%20(6744_20180122_100420).pdf

(2) http://www.oecd.org/pisa/aboutpisa/

(3) Quels sont les frais liés à ces tests Pisa ? Tous les pays participant aux tests Pisa paient une taxe de participation, conformément aux normes établies au niveau international et répartie sur 3 ans (par exemple, 45.000 euros pour l'année 2018). D'autre part, sont imputables aux budgets nationaux tous les frais liés à l'organisation même de ces tests, comme la formation des administrateurs et correcteurs (pour la FWB, c'est l'Université de Liège qui se charge de celle-ci), le support matériel des tests (la Roumanie, par exemple, a opté cette année pour la présentation "papier"; les autres pays utilisent les questionnaires informatisés - matériel à prévoir dans leur budget).

(4) Pour le détail de l'organisation sur 3 ans d'ici les tests 2018 : https://pisa.educa.ch/fr/pisa-2018; sur les tests eux-mêmes :

http://pisa.educa.ch/sites/default/files/uploads/2017/12/pisa_brochure_fr_digitale.pdf

(5) La liste des pays participant aux tests changeant lors de chaque session, il n’est pas étonnant qu’un pays perde ou gagne une place dans le "classement".

(6) Le choix de s’adresser à la population de cet âge se justifie par le fait que c’est normalement autour de 15 ans que l’école obligatoire se termine dans la majorité des pays et il est ainsi possible d'effectuer des comparaisons valables.

Le tirage des échantillons s’effectue en deux étapes. Dans un premier temps, on sélectionne les écoles proportionnellement à leur grandeur, c’est-à-dire à leur nombre total de jeunes de 15 ans. Dans un deuxième temps, on sélectionne également de manière aléatoire les élèves au sein des écoles tirées.

(7) "Littératie" : le terme ne désigne pas la littérature (dans sa capacité à produire ou à comprendre un texte littéraire), mais la compétence à appréhender les questions se rapportant à un texte "littéraire".

(8) Les items relatifs à la “littératie” présentent un texte différent par leur format et leur structure rhétorique (description, narration, ... ) et présentant différentes stratégies et intentions du lecteur (localiser une info, intégrer, interpréter, évaluer, ...). Les textes portent toujours sur des situations de la vie courante d'adultes ou de jeunes. Il n'y a pas de production écrite (par ex., une rédaction), juste la réponse aux questions. Les tests relatifs aux mathématiques portent sur la réalisation d'opérations mathématiques et sur l'application des maths dans la vie réelle. Enfin, les tests portent sur les sciences en fonction des problématiques modernes (accent des tests mis sur la santé et la maladie, les ressources naturelles, la qualité de l’environnement, les risques et les limites des sciences et de la technique, ...).

(9) Le rapport OCDE sur les tests 2015 : http://ses.ens-lyon.fr/actualites/rapports-etudes-et-4-pages/pisa-2015-le-bien-etre-des-eleves-ocde-janvier-2018

(10) https://www.science.lu/fr/content/pisa-«-made-luxembourg-»-l’université-du-luxembourg-met-au-point-une-partie-du-test-2018

(11) http://pisa.educa.ch/sites/default/files/uploads/2017/12/pisa_brochure_fr_digitale.pdf (d’où sont issus les deux documents apparaissant dans le texte ci-dessus)

(12) Qu'il me soit permis ici de remercier Catherine Rosier pour ses conseils de lecture, dont celle de l'article de M. Romainville :

https://pure.fundp.ac.be/ws/files/978232/40051.pdf

(13) Par exemple, les Hollandais essaient de répondre à toutes les questions, mais ont tendance à se hâter vers la fin et à plutôt deviner les réponses; les Autrichiens et les Allemands sautent certains items dès le départ pour avoir assez de temps pour la suite; les Grecs sont d’abord surpris et sous pression pour la fin, ce qui entraîne un score moins bon.

(14) Citons par exemple le Liechtenstein (ce pays minuscule, un des pays les plus riches du monde, a un panel de 417 élèves : c’est un peu comme comparer Neuilly aux USA !) ou Shanghai, Macao, Hong Kong (qui ne sont pas représentatifs de leur pays, la Chine !)

“Bibliographie”

http://pedrocordoba.blog.lemonde.fr/2012/12/27/pisapirlstimss-competences-et-connaissances-1/

http://www.lemonde.fr/.../l-enquete-pisa-sur-le-niveau... (y compris les commentaires)

http://blog.francetvinfo.fr/.../pisa-comparaison-nest-pas...

http://education.blog.lemonde.fr/.../doutes-sur-pisa.../

https://www.letemps.ch/.../suisse-se-revolte-contre...

http://www.ouvroir.info/libresfeuillets/?p=88http://www.laviedesidees.fr/PISA-une-enquete-bancale.html

http://www.lefigaro.fr/.../31003-20161207ARTFIG00300-pour...

https://www.ctf-fce.ca/.../OCDE-%20PISA-et-effets-sur-la...

https://paulvannier.wordpress.com/2016/12/06/pisa-rompre/

http://skhole.fr/mots-clés/pisa

http://www.laviemoderne.net/.../60-nouvelle-livraison-de...

http://eduveille.hypotheses.org/306

https://www.franceinter.fr/.../un-jour-dans-le-monde-19...

https://www.maif.fr/.../maif-pisa-etudes-internationales.pdf

http://www.men.public.lu/.../150203-brochure-pisa-fr.pdf

http://www.cndp-erpent.be/pdf/PISA-2015.pdf (lettre aux parents, collège d’Erpent, Pisa 2015)

http://theconversation.com/comment-lire-la-prochaine-enquete-pisa-69430?utm_source=facebook&utm_medium=facebookbutton (article de 2016)

https://lookaside.fbsbx.com/file/Evaluations%20internationales%20%20%20Pisa%202003%20-% ... (Pisa 2003, dominante math)

http://pedrocordoba.blog.lemonde.fr/.../la-finlande-au.../http://www.ceppecs.eu/?p=1117 (le mirage finlandais)

En plus des épreuves « matières », les élèves sont invités à remplir différents questionnaires contextuels. Cela concerne leurs caractéristiques personnelles (sexe, milieu socio-économique, langue parlée à la maison, organisation de la famille,...), leur attitude envers l’apprentissage et l’école, leurs loisirs, leurs habitudes et point de vue sur les cours, leur motivation dans le contexte scolaire, .... (9)

ET FAUX AUSSI. En 2018, pourront apparaître de nouveaux items (en réalité, leur présence est laissée à l'appréciation et au libre choix de chaque pays participant et nous ne savons donc pas ce qu’il en sera pour la Belgique). Ce sont les "global competence" et la "financial literacy".

Le module “compétence globale” (global competence) : Pearson, une entreprise privée sise aux Etats-Unis et spécialisée dans la formation, travaille actuellement à la définition du contenu du domaine global competence proposé à titre d’option. Les premières ébauches donnent l’impression qu’il s’agit d’une notion très large, difficile à appréhender et à mesurer dans une comparaison internationale. Ainsi, la maîtrise de langues étrangères devrait sans doute être considérée comme un élément important d’une global competence pour un élève suisse, alors qu’elle serait secondaire pour un élève américain. Le concept développé ne donne pour l’instant pas d’indications claires quant à la manière de gérer ces exigences différenciées dans une comparaison internationale. C’est la raison pour laquelle ce concept a été discuté de façon critique au sein du PISA Governing Board (PGB). On ne sait pas, pour l’instant, quels pays introduiront ce module, même si la contribution de Christoph Kemper (Université de Luxembourg) est achevée depuis l’automne 2015. (10)

L'option "culture financière" (financial literacy) : l’option culture financière a déjà rejetée par certains pays - dont la Belgique - pour PISA 2012 et PISA 2015 car, à quelques exceptions près, l’enseignement de connaissances financières spécifiques ne faisait pas partie des matières obligatoires alors en vigueur dans les programmes scolaires. Pour PISA 2018, cet état de fait n’aura pas fondamentalement changé, mais rien n'empêchera un pays d'inclure ce module "culture financière" dans les tests de cette année !

5. Les élèves reçoivent le résultat chiffré de leur "prestation", soit personnellement, soit par le biais de leur école.

FAUX ! Les élèves ne sont que des échantillons. D'ailleurs, ils ne répondent pas aux tests sous leur nom, mais avec le numéro de code qui leur a été attribué. En outre, les réponses n’ont pas la même valeur, puisque les élèves sont cotés non sur leurs réponses, mais sur leurs compétences à répondre.

De plus, les administrateurs Pisa “extrapolent” les réponses, puisque tous les élèves ne reçoivent pas le même questionnaire (celui-ci leur ayant été octroyé de façon aléatoire).

6. Les questionnaires Pisa ne comportent que des questions destinées aux élèves.

FAUX ! Les directions d’école reçoivent également des questionnaires portant sur les caractéristiques démographiques de leur établissement scolaire, les ressources de l'école, la qualité de l'environnement d'apprentissage et sur la collaboration avec les parents. Les renseignements contextuels obtenus via ces questionnaires sont mis en relation avec les résultats et sont très utiles à leur interprétation. Ils permettent de comparer les résultats internationaux sous différents angles : ampleur des différences entre les scores des filles et des garçons, liens entre les résultats obtenus et les sommes d’argent investies par les différents pays dans l’enseignement, réussite des élèves provenant de milieux socio-économiquement défavorisés, etc. Ces différentes analyses permettent notamment de mettre en évidence que certains systèmes éducatifs sont plus inégalitaires que d’autres.

Les parents sont également questionnés sur le parcours précédent de leur enfant, leur attitude personnelle par rapport au sujet des tests Pisa (sciences, mathématiques, “littératie”) et sur la perception qu’a leur enfant de l'école. A noter toutefois que, sans doute par souci d'économie, les tests Pisa en FWB ne présentent pas ce volet "parental".

7. Les tests Pisa servent à classer les pays sur une échelle de performance ???

FAUX ! Le but de cette enquête PISA est clairement double : comparer, tous les 3 ans, les élèves d'environ 15 ans dans un certain nombre de pays et amener les pays moins performants à adopter les réformes des pays plus performants.

Pourquoi alors apparaît-il si important de participer à ces tests ?

“Tout d'abord, participer à l’enquête PISA permet aux systèmes éducatifs et aux gouvernements d’identifier les points forts et les aspects encore à améliorer. En deuxième lieu, PISA offre la possibilité de comparer, au niveau international, les compétences des élèves ainsi que les systèmes éducatifs. La comparaison permet de se positionner dans le contexte international et d'apprendre par la comparaison des systèmes éducatifs des différents pays participants. Troisièmement, les données collectées à travers l’enquête PISA ne donnent pas uniquement la possibilité de monitorer les compétences scolaires des élèves mais livrent également des informations sur la vie scolaire et extrascolaire des élèves de 15 ans. Ces informations peuvent être utilisées pour améliorer les méthodes d’apprentissage en les adaptant aux attentes et aux pratiques des élèves. Enfin, grâce à l’approche par compétences, le programme PISA mesure également le niveau de préparation des élèves, lorsqu’ils sont confrontés à des situations nouvelles, que ce soit dans un contexte scolaire, personnel ou professionnel.” (11)

DONC, PISA, FINALEMENT ?

Sans contester le fait que l'enseignement doit sans cesse s'évaluer et être évalué, l'organisation des tests Pisa et surtout leur philosophie et leur utilisation nous semblent erronées sur plusieurs points, voire dangereuses. En voici quelques-uns. Ironie suprême, ils rejoignent l'avis qu'exprima, en 2002, dans la Revue Nouvelle, le professeur Marc Romainville ( oui, celui qui a travaillé plus qu'activement dans la construction du Pacte Pour un Enseignement d'Excellence ! (12)

1/ Les tests Pisa, tels qu'organisés actuellement, ne tiennent pas compte de la spécificité des programmes éducatifs nationaux, ni du volume horaire de chaque discipline, ni du pourcentage d'allophones (et du fait que les “testés” sont issus de 50 nationalités différentes), ni des antécédents culturels différents (pensez, par exemple à l'histoire de la Finlande). Or ces antécédents culturels entraînent les réactions différentes des élèves devant les questions. (13)

Les tests Pisa ne tiennent pas compte non plus de la fraction d'élèves scolarisés d'un pays à un autre, et donc du taux de représentativité. Ainsi, 95% des jeunes sont scolarisés en Grande-Bretagne, 55% seulement au Brésil; Shanghai exclut de la scolarité les enfants de migrants du reste de la Chine (et l'OCDE ferme les yeux sur cette ségrégation). La temporalité de l'apprentissage est aussi totalement oubliée. Or, il nous semble évident à nous, les "gens du terrain", qu'il ne faut pas confondre ce qu'un enfant sait faire à 15 ans et ce qu'il saura ou pourra faire (cf., à ce propos, le problème de la Finlande au niveau de son enseignement supérieur !)

Sont occultés aussi deux écueils inhérents à ce genre de tests : leur marge d'erreur et ne disons pas le "mensonge", mais plus consensuellement, l’amour-propre, la volonté d'embellir ou, au contraire, de dramatiser, voire l’ignorance dans le chef de certains pays, de certaines directions d’école, de certains parents.

Dans les faits, les résultats Pisa ne montrent que des écarts d'un test à l'autre, d'un pays à l'autre, avec des pourcentages, en fait, très petits.

Enfin, un aspect échappe, volontairement ou non, aux organisateurs des tests : le coût de ces enquêtes pour les petits pays, au point que, pour des raisons de budget, certains font l’impasse sur une partie des tests.

2/ On l'a vu aussi, les tests n'évaluent que trois domaines (les mathématiques, les sciences et la “littératie”) - sans tenir compte d'autres cours considérés comme accessoires et pourtant participant aussi à la formation des élèves (tels l'histoire, la géographie, les langues étrangères, les langues anciennes, ...) au risque de reléguer ces cours jugés "inutiles" et de mépriser des connaissances et compétences transversales indispensables (ex. les gammes, les langues anciennes, ...)

3/ On est en droit de se demander si la base-même des tests Pisa n’est pas bancale. En effet, ils se fondent sur une idée de "socle commun" national et international, d'un acquis de base national et international. Or, il existe un grand nombre de redoublements - entre autres en France et en FWB - et tous les élèves de 15 ans, en l'occurrence ici les "testés", ne sont pas à niveau pour les connaissances et la maturité. Dans le même ordre d’idée, notons que, alors que les programmes nationaux présentent une approche différente sur la construction d'un savoir à longue durée, les tests, eux, sont en dehors de toute considération des programmes nationaux.

Deuxièmement, les tests canalisent les objectifs éducatifs en installant une concurrence entre les écoles ou les pays. Outre le fait d'une mauvaise utilisation des tests eux-mêmes, les tests n'ayant pas pour but de classer, mais de comparer ! - cela entraîne un appauvrissement des curricula scolaires : l’enseignement tend à être recentré sur les compétences de base telles qu'utilisées par les tests (juste pour grimper dans le classement). Ces deux derniers points entraînent une perte de qualité de l’enseignement et, aspect tout aussi grave, les pays perdent la maîtrise de leur éducation formelle et de ses finalités profondes.

Troisièmement, les tests mesurent des compétences de la vie réelle. C’est un déni du droit à l'enfance, l'élève n'étant vu et testé que comme un adulte en miniature !

4/ Un problème réside dans l'utilisation, depuis 2015, de questionnaires informatisés, sans avoir au préalable posé la question de savoir quels effets l’utilisation de ce matériel aurait sur les élèves. Or certains problèmes et faiblesses de ces tests informatisés sont apparus en 2015 (difficulté de certains jeunes à les utiliser; impossibilité de revenir en arrière sur une réponse; comportement différent des élèves devant l'ordinateur selon leur nationalité - encore un point de vue culturel occulté). En outre, le recours à l’ordinateur aux tests 2015 a présenté un problème de méthodologie : il y a eu le changement du prestataire chargé de l'enquête (l'américain ETS au lieu de l'australien ACER). Or, les deux prestataires n’ont pas tout à fait la même méthode d'évaluation, ce qui explique partiellement la chute des scores aux tests 2015 - ceux qui, en FWB, ont justifié la mise en construction du Pacte Pour un Enseignement d'Excellence !

5/ Les questions elles-mêmes posent aussi problème. Déjà du temps des questionnaires "papier-crayon", certains avaient attiré l'attention sur une difficulté liée à la langue-même des questions (certaines langues sont moins concises que d'autres, comme le français, 15% plus long que l'anglais). Certains items sont des questions-pièges, surtout pour des adolescents : insertion dans l'énoncé d'informations inutiles; exigence d'une réponse unique, alors que le bon sens en admettrait plusieurs; demande de réponse sans préciser que plusieurs sont attendues; points attribués non pas pour la compréhension d'un texte, mais pour la compréhension de la question du test Pisa (termes abstraits, ...).

Les tests Pisa présentent un autre danger : celui du bachotage (surtout si l’évaluation des professeurs se fait selon les taux de "réussite" de leurs élèves, comme cela se fait déjà dans un Etat des USA où les enseignants reçoivent rémunération ou sanction selon le score de leurs élèves aux tests Pisa !). Sans en arriver à ces extrêmes, il est tentant de bachoter : en effet, les questionnaires des années précédentes circulent sur le net, facilité et possibilité qui poussent certains enseignants, écoles ou pays, à entraîner les élèves. Le risque est grand alors que, dans leurs cours, les professeurs mettent l'accent sur "comment réussir les tests ?", aux dépens d'autres tâches importantes, et qu'en fait, Pisa n'évalue plus les compétences pour répondre aux tests, mais bien la connaissance du test lui-même, ses trucs, ses pièges (un de ces pièges étant la formulation-même des questions, puisque, pour la plupart des élèves testés, elles sont la traduction des items anglais et français. cf. supra)

6/ L'évaluation Pisa met sur le même pied des pays socialement et économiquement différents, c'est-à-dire, en fait, non pas des pays à des stades différents de développement, mais - comme le dit l'OCDE - "des pays et des économies partenaires" ! Est-ce admissible que ces tests comparent nos élèves à ceux de Corée du S., où les cours particuliers occupent une énorme place ? nos élèves à ceux de Shanghai, où tous les élèves ne sont pas scolarisés ? nos élèves à ceux des régions chinoises en plein développement industriel, financier et économique (ainsi, Shanghai, Hong Kong, Macao) et peu représentatives du reste de la Chine ? En quoi les résultats des tests sont-ils significatifs, lorsqu'on compare avec des pays confettis ou de simples villes ? (13) Est-il scientifiquement "honnête" de comparer avec certains pays où existe un système éducatif parallèle, toujours très onéreux pour les parents, se superposant au système national (ex. Grèce, Corée) ?

7/ On compare des chiffres sans savoir ce que l'on compare (ça fait moderne et scientifique ! ). Les scores moyens d'un pays sont souvent affectés d'une marge d'erreur (~ 5%) dans le décodage des réponses. Ainsi, un score 523 dans un test Pisa représente en fait un score de 518 à 528 - ce qui peut changer totalement le score et la place d’un pays dans le classement !

8/ Dans les rapports de synthèse de l'OCDE, on constate que tous les pays enseignant par compétence (comme la Belgique) au détriment des savoirs voient leurs scores chuter. En effet, une compétence se travaille mais ne s'enseigne pas ! Pourtant, les tests Pisa continuent à "estimer dans quelle mesure les élèves disposent des compétences pour jouer un rôle actif dans la société" ! (2)

9/ Les médias jouent un grand rôle dans la publication des résultats des tests : ce sont eux qui mettent en avant un classement, un palmarès. Par là-même, ce sont eux qui créent un sentiment de culpabilité et ouvrent largement la porte aux changements politiques d'organisation scolaire, à une "refondation de l'école".

En conclusion, l'esprit général de Pisa apparaît très fortement critiquable et dangereux : il implique une logique de court terme, à savoir la préparation d'individus employables et flexibles. Pisa participe donc à une marchandisation de l’enseignement, sans réflexion politique sur les valeurs et le but de l’enseignement, mais bien sur son coût et sa rentabilité !

(1) http://www.enseignement.be/index.php?page=25703&ne_id=5339 - FWB, circulaire 6500, du 22/01/2018 :

http://enseignement.be/upload/circulaires/000000000003/FWB%20-%20Circulaire%206500%20(6744_20180122_100420).pdf

(2) http://www.oecd.org/pisa/aboutpisa/

(3) Quels sont les frais liés à ces tests Pisa ? Tous les pays participant aux tests Pisa paient une taxe de participation, conformément aux normes établies au niveau international et répartie sur 3 ans (par exemple, 45.000 euros pour l'année 2018). D'autre part, sont imputables aux budgets nationaux tous les frais liés à l'organisation même de ces tests, comme la formation des administrateurs et correcteurs (pour la FWB, c'est l'Université de Liège qui se charge de celle-ci), le support matériel des tests (la Roumanie, par exemple, a opté cette année pour la présentation "papier"; les autres pays utilisent les questionnaires informatisés - matériel à prévoir dans leur budget).

(4) Pour le détail de l'organisation sur 3 ans d'ici les tests 2018 : https://pisa.educa.ch/fr/pisa-2018; sur les tests eux-mêmes :

http://pisa.educa.ch/sites/default/files/uploads/2017/12/pisa_brochure_fr_digitale.pdf

(5) La liste des pays participant aux tests changeant lors de chaque session, il n’est pas étonnant qu’un pays perde ou gagne une place dans le "classement".

(6) Le choix de s’adresser à la population de cet âge se justifie par le fait que c’est normalement autour de 15 ans que l’école obligatoire se termine dans la majorité des pays et il est ainsi possible d'effectuer des comparaisons valables.

Le tirage des échantillons s’effectue en deux étapes. Dans un premier temps, on sélectionne les écoles proportionnellement à leur grandeur, c’est-à-dire à leur nombre total de jeunes de 15 ans. Dans un deuxième temps, on sélectionne également de manière aléatoire les élèves au sein des écoles tirées.

(7) "Littératie" : le terme ne désigne pas la littérature (dans sa capacité à produire ou à comprendre un texte littéraire), mais la compétence à appréhender les questions se rapportant à un texte "littéraire".

(8) Les items relatifs à la “littératie” présentent un texte différent par leur format et leur structure rhétorique (description, narration, ... ) et présentant différentes stratégies et intentions du lecteur (localiser une info, intégrer, interpréter, évaluer, ...). Les textes portent toujours sur des situations de la vie courante d'adultes ou de jeunes. Il n'y a pas de production écrite (par ex., une rédaction), juste la réponse aux questions. Les tests relatifs aux mathématiques portent sur la réalisation d'opérations mathématiques et sur l'application des maths dans la vie réelle. Enfin, les tests portent sur les sciences en fonction des problématiques modernes (accent des tests mis sur la santé et la maladie, les ressources naturelles, la qualité de l’environnement, les risques et les limites des sciences et de la technique, ...).

(9) Le rapport OCDE sur les tests 2015 : http://ses.ens-lyon.fr/actualites/rapports-etudes-et-4-pages/pisa-2015-le-bien-etre-des-eleves-ocde-janvier-2018

(10) https://www.science.lu/fr/content/pisa-«-made-luxembourg-»-l’université-du-luxembourg-met-au-point-une-partie-du-test-2018

(11) http://pisa.educa.ch/sites/default/files/uploads/2017/12/pisa_brochure_fr_digitale.pdf (d’où sont issus les deux documents apparaissant dans le texte ci-dessus)

(12) Qu'il me soit permis ici de remercier Catherine Rosier pour ses conseils de lecture, dont celle de l'article de M. Romainville :

https://pure.fundp.ac.be/ws/files/978232/40051.pdf

(13) Par exemple, les Hollandais essaient de répondre à toutes les questions, mais ont tendance à se hâter vers la fin et à plutôt deviner les réponses; les Autrichiens et les Allemands sautent certains items dès le départ pour avoir assez de temps pour la suite; les Grecs sont d’abord surpris et sous pression pour la fin, ce qui entraîne un score moins bon.

(14) Citons par exemple le Liechtenstein (ce pays minuscule, un des pays les plus riches du monde, a un panel de 417 élèves : c’est un peu comme comparer Neuilly aux USA !) ou Shanghai, Macao, Hong Kong (qui ne sont pas représentatifs de leur pays, la Chine !)

“Bibliographie”

http://pedrocordoba.blog.lemonde.fr/2012/12/27/pisapirlstimss-competences-et-connaissances-1/

http://www.lemonde.fr/.../l-enquete-pisa-sur-le-niveau... (y compris les commentaires)

http://blog.francetvinfo.fr/.../pisa-comparaison-nest-pas...

http://education.blog.lemonde.fr/.../doutes-sur-pisa.../

https://www.letemps.ch/.../suisse-se-revolte-contre...

http://www.ouvroir.info/libresfeuillets/?p=88http://www.laviedesidees.fr/PISA-une-enquete-bancale.html

http://www.lefigaro.fr/.../31003-20161207ARTFIG00300-pour...

https://www.ctf-fce.ca/.../OCDE-%20PISA-et-effets-sur-la...

https://paulvannier.wordpress.com/2016/12/06/pisa-rompre/

http://skhole.fr/mots-clés/pisa

http://www.laviemoderne.net/.../60-nouvelle-livraison-de...

http://eduveille.hypotheses.org/306

https://www.franceinter.fr/.../un-jour-dans-le-monde-19...

https://www.maif.fr/.../maif-pisa-etudes-internationales.pdf

http://www.men.public.lu/.../150203-brochure-pisa-fr.pdf

http://www.cndp-erpent.be/pdf/PISA-2015.pdf (lettre aux parents, collège d’Erpent, Pisa 2015)

http://theconversation.com/comment-lire-la-prochaine-enquete-pisa-69430?utm_source=facebook&utm_medium=facebookbutton (article de 2016)

https://lookaside.fbsbx.com/file/Evaluations%20internationales%20%20%20Pisa%202003%20-% ... (Pisa 2003, dominante math)

http://pedrocordoba.blog.lemonde.fr/.../la-finlande-au.../http://www.ceppecs.eu/?p=1117 (le mirage finlandais)